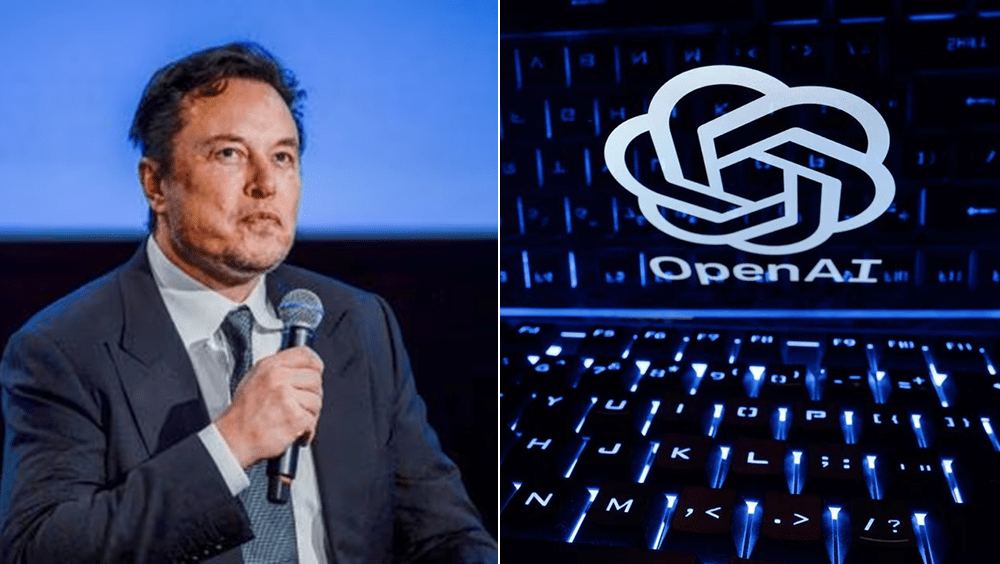

危及社會與人類 馬斯克與專家聯署呼籲暫停訓練更強大AI至少半年

發佈時間:16:28 2023-03-29 HKT

Telsa行政總裁馬斯克(Elon Musk)與一群人工智能(AI)專家、業界高層,共同發表公開信,呼籲暫停訓練比GPT-4還強大的AI系統,理由是有可能危及社會與人類。目前,這封信已有1079名科技領袖和研究人員簽名,除了馬斯克、辛頓和馬庫斯之外,還包括圖靈獎得主約書亞·本希奧(Yoshua Bengio)、《人工智能:現代方法》作者羅素(Stuart Russell)、 蘋果公司聯合創始人沃茲尼亞克(Steve Wozniak)、Stability AI首席執行官莫斯塔克(Emad Mostaque)等科技界領袖人物。

美國未來生命研究所(Future of Life Institute)29日公佈一封公開信,呼籲所有AI實驗室立即暫停訓練比GPT-4更強大的AI系統至少6個月。信中寫道:廣泛的研究表明,具有與人類競爭智能的人工智能系統可能對社會和人類構成深遠的風險,這一觀點得到了頂級人工智能實驗室的承認。正如廣泛認可的「阿西洛馬人工智能原則(Asilomar AI Principles,阿西莫夫的機械人三大法則的擴展版本,於2017年由近千名人工智能和機械人專家簽署)中所述,高級AI可能代表地球生命史上的深刻變化,應該以相應的關照和資源進行規劃和管理。不幸的是,這種級別的規劃和管理並沒有發生,儘管最近幾個月人工智能實驗室陷入了一場失控的競賽,以開發和部署更強大的數字思維,沒有人(甚至他們的創造者)能理解、預測或可靠地控制。

「當代人工智能系統現在在一般任務上變得與人類具有競爭力,我們必須捫心自問:我們是否應該讓機械用宣傳和謊言充斥我們的信息渠道?我們是否應該自動化所有工作,包括令人滿意的工作?我們是否應該發展最終可能比我們更多、更聰明,淘汰並取代我們的非人類思維?我們應該冒險失去對我們文明的控制嗎?」這封信寫道,「只有當我們確信它們的影響是積極的並且風險是可控的時候,才應該開發強大的人工智能系統。這種信心必須有充分的理由,並隨著系統潛在影響的規模而增加。OpenAI最近關於通用人工智能的聲明指出,『在某些時候,在開始訓練未來的系統之前進行獨立審查可能很重要,並且對於最先進的工作來說,應該同意限制用於創建新模型的計算量增長。』我們同意。那個某些時候就是現在。」

這封信呼籲,所有人工智能實驗室立即暫停訓練比GPT-4更強大的人工智能系統至少6個月。這種暫停應該是公開的和可驗證的,並且包括所有關鍵參與者。如果不能迅速實施這種暫停,政府應介入並實行暫停。人工智能實驗室和獨立專家應該利用這次暫停,共同開發和實施一套用於高級人工智能設計和開發的共享安全協議,並由獨立的外部專家進行嚴格審計和監督。這些協議應確保遵守它們的系統是安全的,並且無可置疑。這並不意味著總體上暫停AI開發,只是緊急從奔向不可預測的大型黑盒模型的危險競賽中收回腳步。

此外,歐盟警察機構Europol本周一呼應對於ChatGPT這類先進AI的倫理與法律擔憂。警告這類AI潛在的網絡釣魚、假訊息、網絡犯罪等不當使用。上述公開信接在Europol表達憂心之後發表。

自從微軟支持的OpenAI去年推出ChatGPT之後,競爭者忙著推出類似產品,多家企業準備把這類技術整合到他們的應用程式或是產品之中。

---

《星島申訴王》於3月1日隆重登場,節目為民請命抱不平、追蹤城中熱話,亦會搜羅溫情小故事。你申訴,我跟進,搵91999933,《星島申訴王》隨時候命!

立即報料: https://bit.ly/3IMunqd

你的獨家報料一旦被採用及報導,將獲得乙份獎品。

《星島頭條》APP經已推出最新版本,請立即更新,瀏覽更精彩內容:https://bit.ly/3yLrgYZ